Doris 日志分析案例

前面我们介绍了Doris在日志分析中的应用,和 Doris 数据集成 Kafka,今天我们来看一个具体的案例,因为日志数据往往都是写到kafka 或者,是通过日志收集工具收集到kafka 中的。

所以我们如果想要使用Doris进行日志分析的话,那我们需要做的一件事情,就是同步数据到Doris,这也就是我们前面介绍的功能 Doris 数据集成 Kafka,只不过我们上一节只是创建了一个测试的topic 和表,这一节我们看一个真实的案例。

配置日志写到Kafka

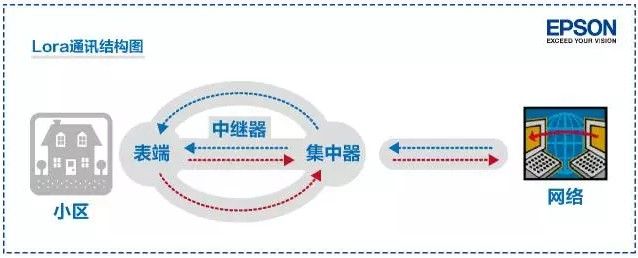

公司目前日志的现状是,日志通过Logstash写到ES ,然后通过Kibana进行分析,这里我们要做的其实很简单,就是在Logstash 的配置文件中,增加一个outpu 即可,我们先让ELK 的这套架构存在着,后面不要的时候,直接删除对应的outpu即可。

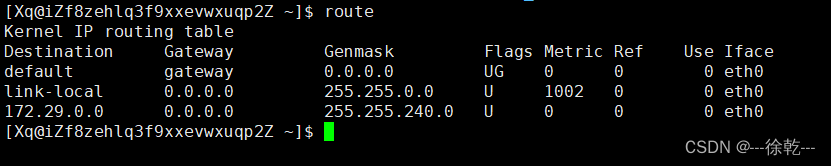

这里我们先创建一个kafka 的topic,因为数据很快就同步到doris 了,所以这里我们直接就一个副本,当然如果你想要安全,可以创建三副本,因为我们这里的日志没那么重要,所以我也不怕它丢失

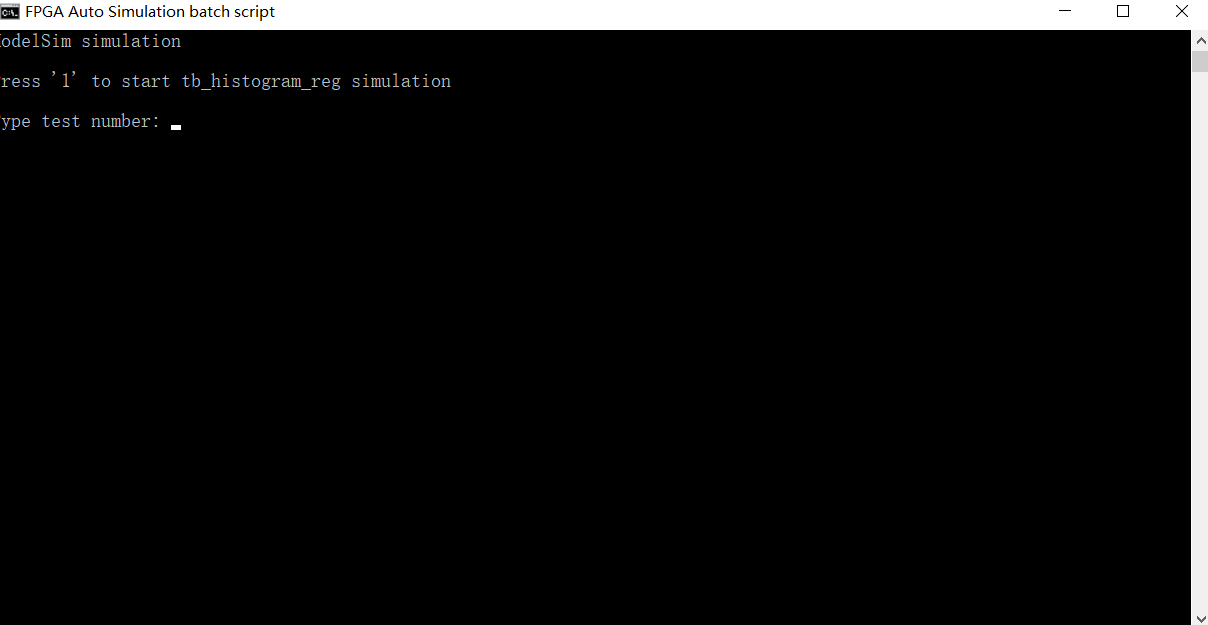

kafka-topics.sh --c